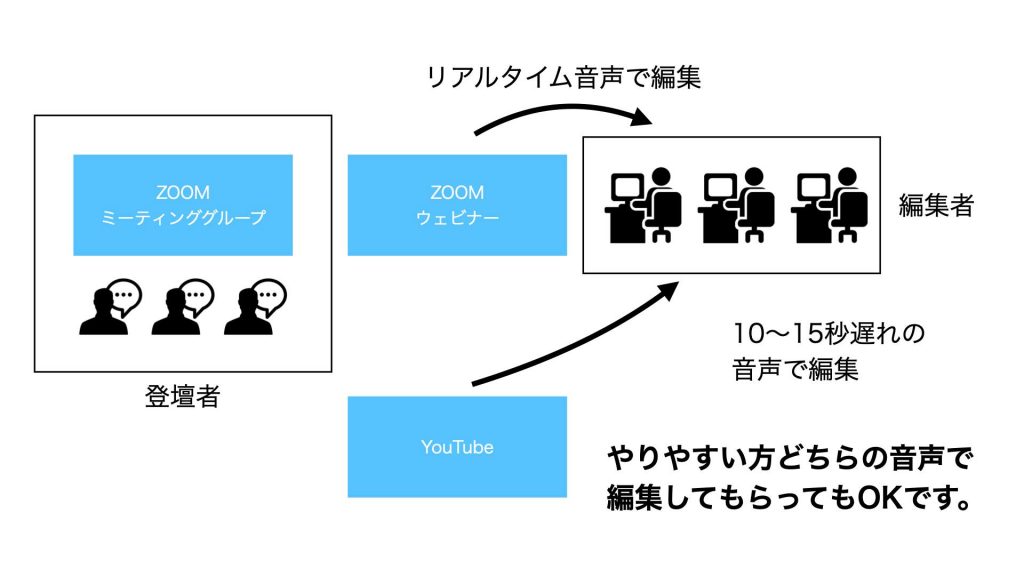

【トピック】GAAD Japanの字幕付き配信のしくみ

5月21日(木)、GAAD JapanというGlobal Accessibility Awareness Day関連のイベントがオンラインで開催されました。UDトークは開催協力ということで字幕付きでYouTube Liveの配信を担当しました。

ご覧になった方はわかると思うのですが、YouTube Liveの画面右1/3はUDトークの字幕、左はZOOMの画面。最初から最後までこのスタイルで配信を行いました。

その仕組を少しご説明します。

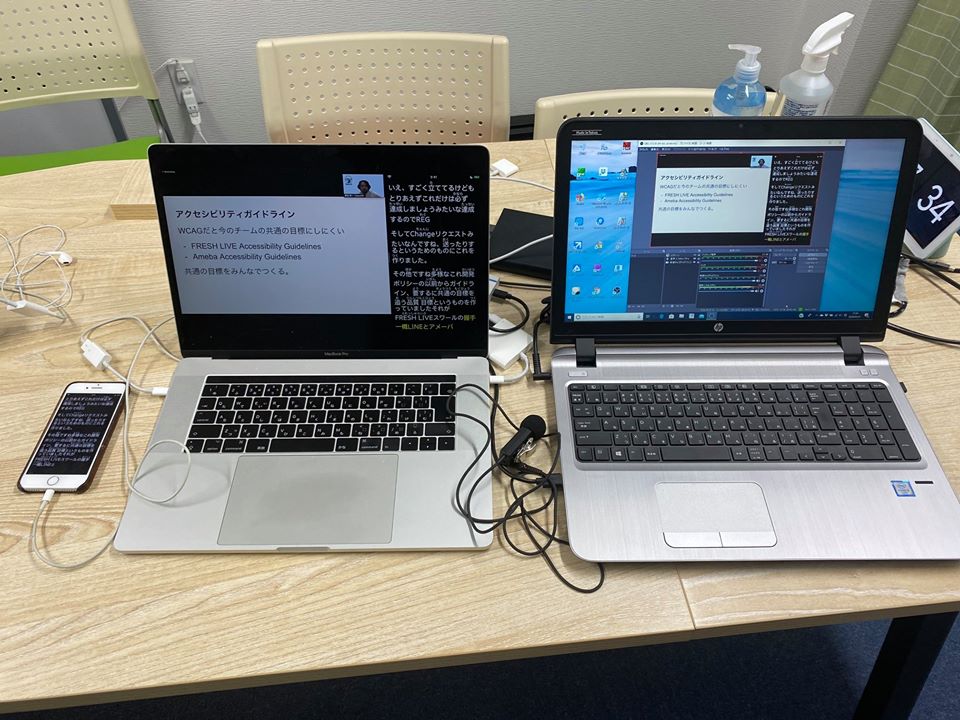

まず一枚目の写真、これが配信部分です。右のWindowsのラップトップでOBSと言うソフトを動かしてYouTube Liveへ配信をしています。OBSは配信をしている方にはおなじみのソフトで音声や画像などいろんなソースのコントロールができます。当日はこれでセッションの間を画像をだしてミュートにし、次の登壇者との打ち合わせを行ったりして進めていきました。

右のMacはZOOMとUDトークを並べて表示しています。この画面をHDMIで出力し、Windowsのラップトップに接続してあるキャプチャデバイスに入力し配信をしています。MacのQuick Time PlayerというアプリがiOSの画面をキャプチャでき、さらにMacはスプリットビューという2画面フルスクリーンができます。これで調整して配置。

ZOOMはカメラをオフにしている人は出ない設定にし、通常はギャラリービュー、登壇中はスピーカービューと切り替わるようにしていました。なので基本配信中はなにも操作をすることなくいい感じの画面で遷移してました。

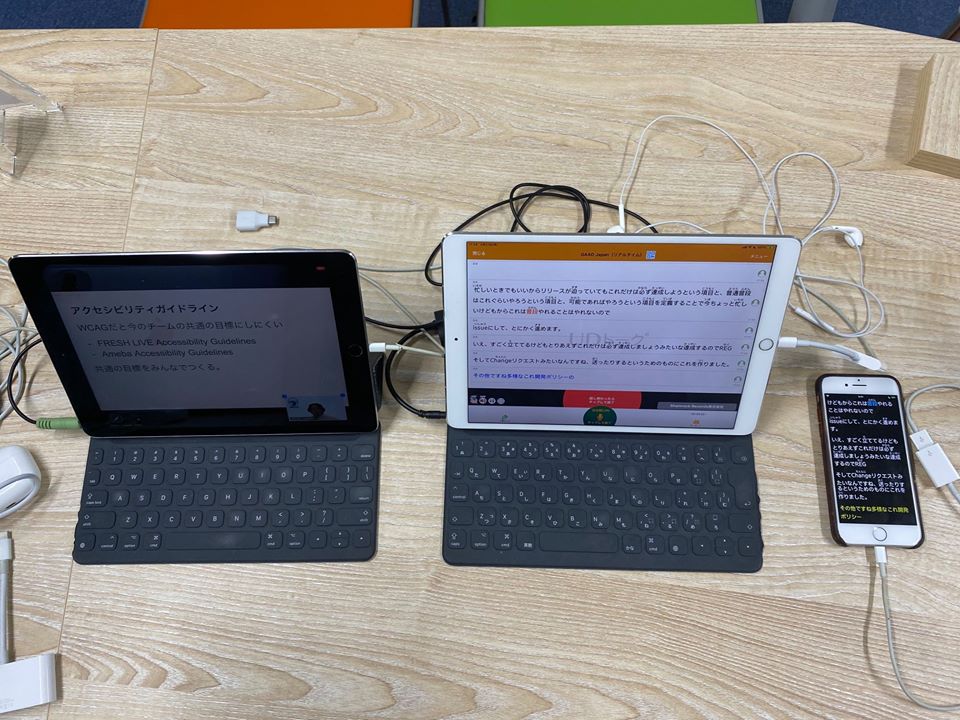

2枚めの写真はUDトークの方です。今回登壇者グループはZOOMでやったのでそこの音声を取り込むためにZOOMをiPadで起動し、その音声をヘッドフォン端子からiRig2を経由してもう一台のiPadに入れてます。ここで音声認識した結果を一枚目の写真のiPhoneにトークの公開で送っています。

そして最後に「タイムラグ」への対応です。YouTube Liveはだいたい20秒くらいの遅延があります。これに対応するために「20秒遅延させて配信する」アプリを開発しました(※公開予定なし、ニーズがあれば出そうかと)。こうすることによって

・YouTubeの画像にはリアルタイムで認識しているUDトーク

・YouTube Liveを見ている人の手元には配信遅延に合わせて表示されるUDトーク

と2つの時間軸で字幕を進行させることに成功しています。

ちょっと機材は多めに使ってますが、数人集まれば用意できると思いますのでぜひやってみてください。

ここまで用意するのは大変!ってかたは、画像に字幕を配信するのを諦めて、配信されているYouTubeの音声を有線でiRig2に取り込み認識させて公開するといいと思います。

何度もリハーサルと検証をしたおかげで配信は大きなトラブルもなく(あったんですが、復帰できました)終えることができました。